Inteligência Artificial DALL-E pode criar qualquer imagem através de descrição em texto!

O programa utiliza uma versão de 12 bilhões de parâmetros do modelo de linguagem autoregressiva

Por Saori Almeida

A OpenAI, empresa de pesquisa em inteligência artificial sediada em San Francisco e fundada por Elon Musk, criou um programa de inteligência artificial apelidada de DALL-E que cria imagens a partir de descrições de texto. O programa utiliza uma versão de 12 bilhões de parâmetros do modelo de linguagem autoregressiva e pode praticamente criar imagens de qualquer coisa.

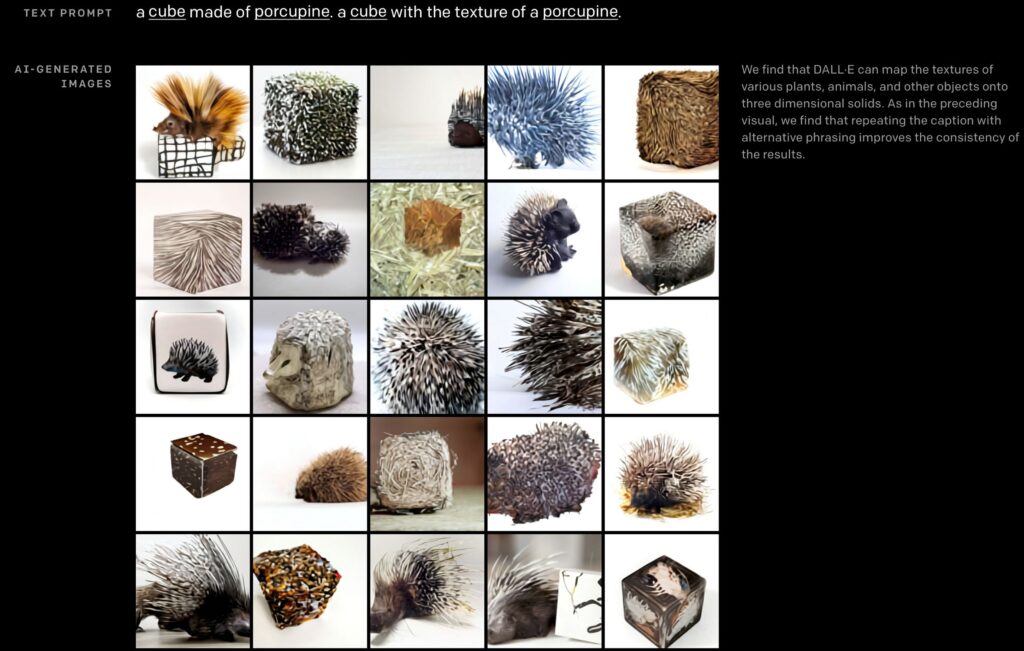

A tecnologia utilizada para que a DALL-E consiga compreender as formas de linguagem, chamada Generative Pre-trained Transformer 3 (GPT-3), também foi desenvolvida pela OpenAI. Pela descrição, o programa cria ilustrações, pinturas, fotos, renderizações, esboços – enfim, qualquer coisa que possa ser identificada através de palavras. No artigo da OpenAI sobre DALL-E, por exemplo, temos “uma poltrona em forma de abacate” que, posteriormente, virou diversas renderizações diferentes. Ao produzir centenas ou milhares de resultados para um determinado prompt, muitos resultados serão bons, mas ocasionalmente alguns…não serão muito “selecionáveis”.

A OpenAI descreve o DALL-E como um “transformador apenas com decodificador simples que recebe o texto e a imagem como um único fluxo de 1280 tokens – 256 para o texto e 1024 para o mesmo – e modela todos eles de forma autoregressiva. […] DALL-E usa a máscara causal padrão para os tokens de texto e atenção esparsa para os tokens de imagem com uma linha, coluna ou padrão de atenção convolucional, dependendo da camada“.

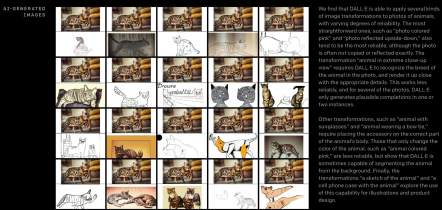

“Descobrimos que [DALL-E] tem um conjunto diversificado de recursos, incluindo a criação de versões antropomorfizadas de animais e objetos, combinando conceitos não relacionados de maneiras plausíveis, renderizando texto e aplicando transformações em imagens existentes.” – OpenAI.

Como o DPreview menciona, O que DALL-E faz não é em si novo, mas o novo programa da OpenAI opera com bastante sucesso e pode lidar com variações de entrada com sucesso variável. Claro, uma imagem gerada de um animal não terá a mesma qualidade ou nitidez de uma imagem genuína capturada por uma câmera digital. Além disso, DALL-E pode se tornar “frágil no que diz respeito à reformulação da legenda’ em cenários desafiadores”.

“Ao contrário de um motor de renderização 3D, cujas entradas devem ser especificadas de forma inequívoca e em detalhes completos, DALL · E é muitas vezes capaz de “preencher os espaços em branco” quando a legenda implica que a imagem deve conter um determinado detalhe que não é explicitamente declarado.” – OpenAI.

A OpenAI descobriu que ‘DALL-E é capaz de renderizar a mesma cena em uma variedade de estilos e pode adaptar a iluminação, sombras e ambiente com base na hora do dia ou estação do ano’, mesmo quando esses detalhes não são especificados.

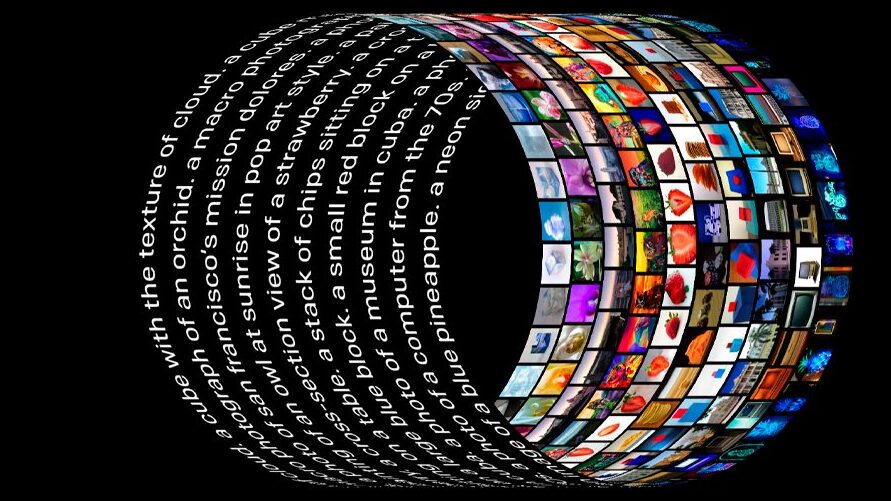

Abaixo, você pode conferir alguns prompts utilizados para treinar a DALL-E:

Saori Almeida é natural do Rio Grande do Sul, técnica em administração formada pelo Centro Tecnológico de Caxias do Sul (CETEC) e estudante de Jornalismo na Universidade Federal de Santa Catarina (UFSC). Gosta da cultura asiática e nerd no geral e tem interesse crescente por tecnologia e games desde pequena – gosto que se intensifica diariamente na redação.